搭建centOS环境

切换root用户

su root

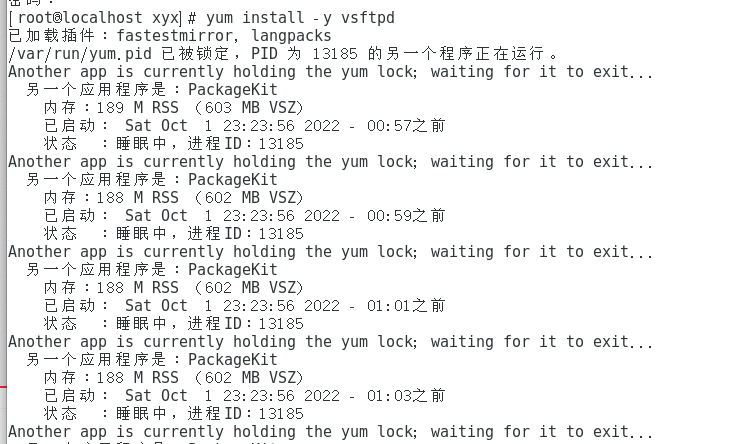

yum install -y vsftpd

如果出现了这个

把这个文件删了

rm -f /var/run/yum.pid

然后再安装

yum install -y vsftpd

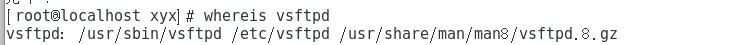

whereis vsftpd

systemctl status vsftpd.service

systemctl start vsftpd.service

systemctl status vsftpd.service

systemctl enable vsftpd.service

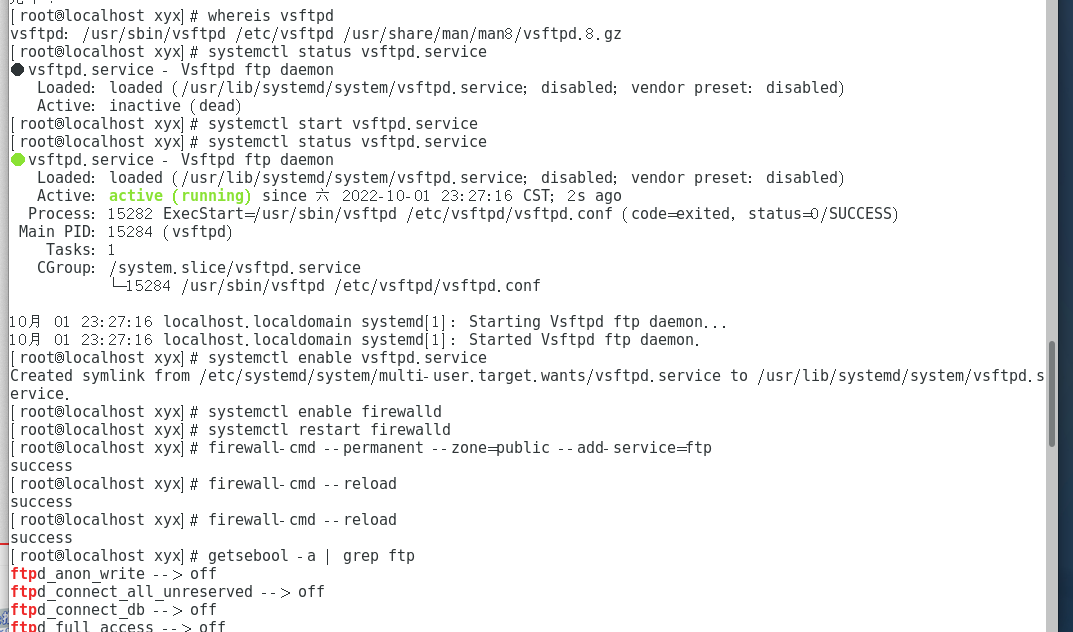

systemctl enable firewalld

systemctl restart firewalld

firewall-cmd --permanent --zone=public --add-service=ftp

firewall-cmd --reload

firewall-cmd --reload

getsebool -a | grep ftp

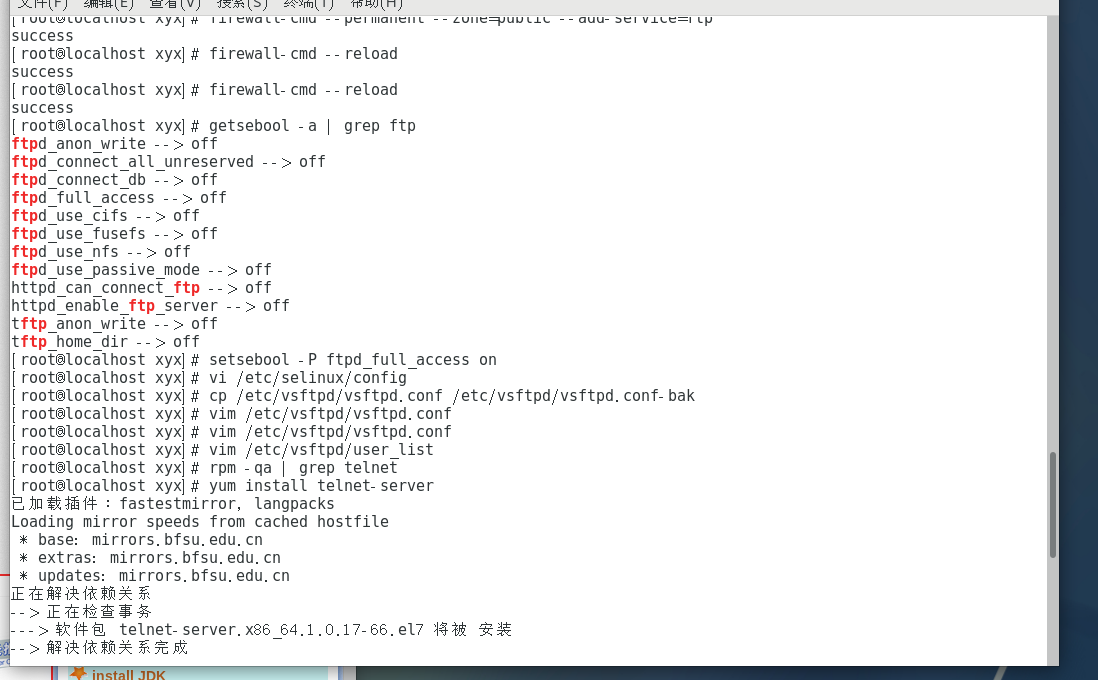

setsebool -P ftpd_full_access on

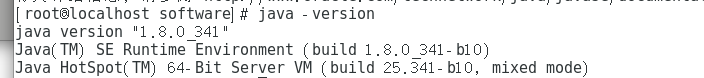

安装java1.8

https://www.jianshu.com/p/8442796bc144

vim /etc/profile

export JAVA_HOME=/home/xyx/software/jdk1.8.0_341

export JRE_HOME=/home/xyx/software/jdk1.8.0_341/jre

export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib:$CLASSPATH

export PATH=$JAVA_HOME/bin:$JRE_HOME/bin:$PATH

source /etc/profile

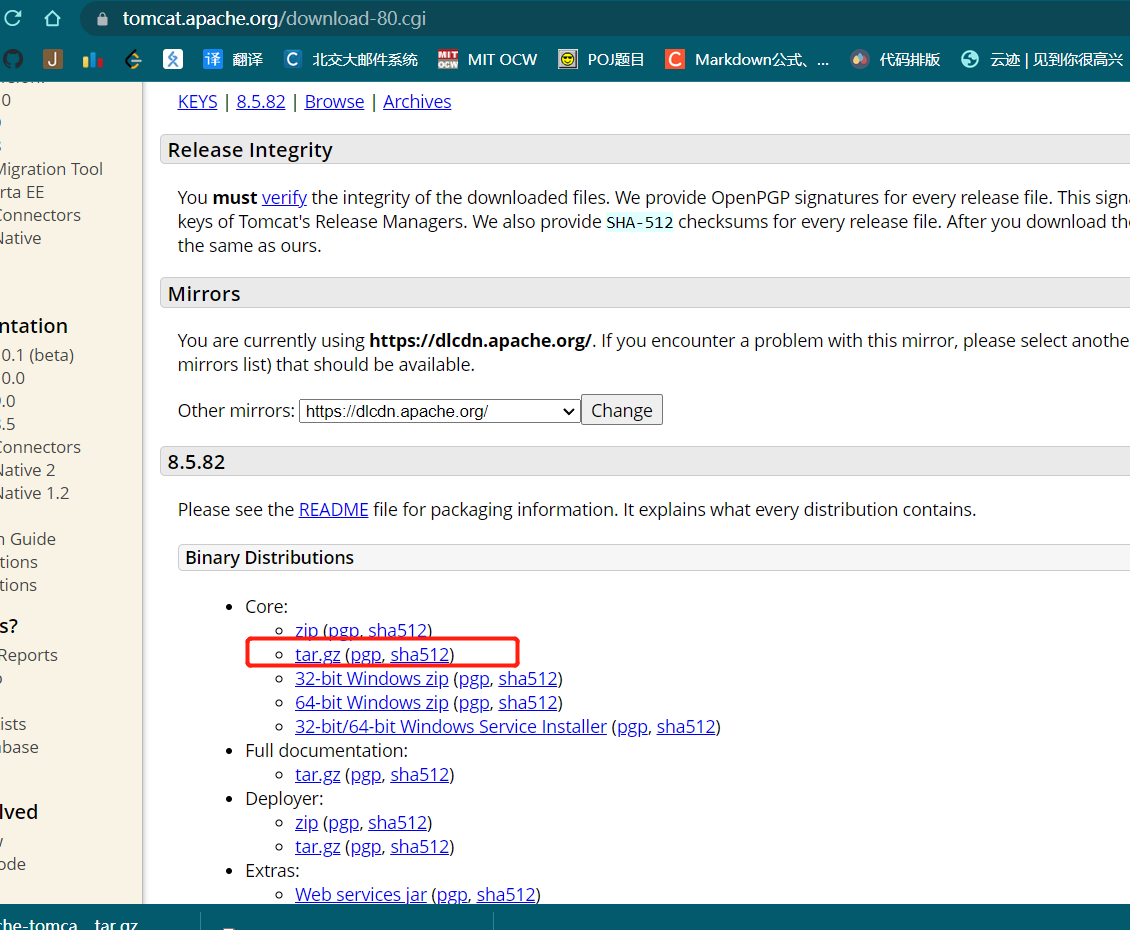

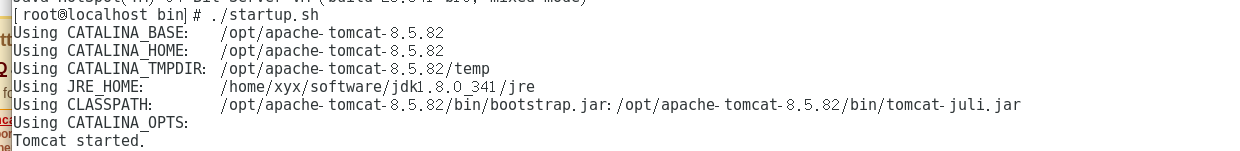

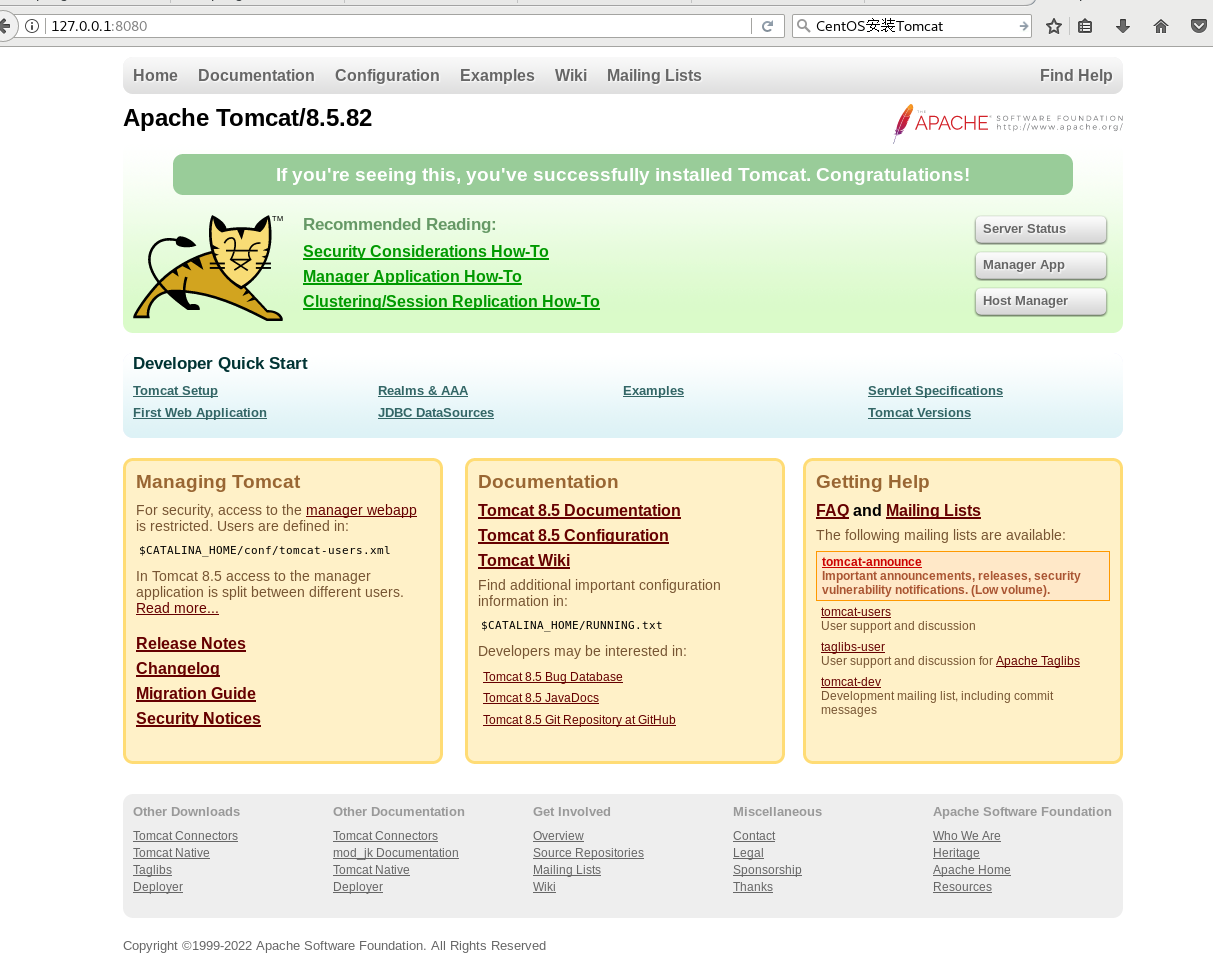

安装tomcat

tar -zxvf apache-tomcat-8.5.82.tar.gz

cp apache-tomcat-8.5.82/ -a /opt/

cd /opt/apache-tomcat-8.5.82/bin

./startup.sh

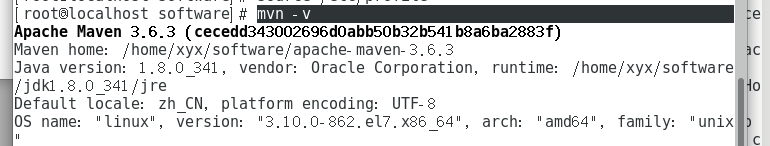

maven

https://blog.csdn.net/rao991207823/article/details/118914715

export MAVEN_HOME=/home/xyx/software/apache-maven-3.6.3

export PATH=$PATH:$MAVEN_HOME/bin

source /etc/profile

mvn -v

## 切入到安装目录

cd /usr/app/maven/apache-maven-3.6.1

## 新建本地仓库目录

mkdir repository

## 编写配置文件中的本地仓库路径和中央镜像地址

vim conf/setttings.xml

## 在注释行 <-- <localRepository>/path/to/local/repo</localRepository> -->后添加

<localRepository>/usr/app/maven/apache-maven-3.6.1/repository</localRepository>

## 在<mirrors>标签中添加如下信息

<mirror>

<id>nexus-aliyun</id>

<mirrorOf>central</mirrorOf>

<name>Nexus aliyun</name>

<url>http://maven.aliyun.com/nexus/content/groups/public</url>

</mirror>

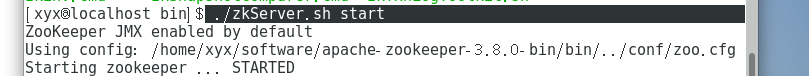

zookeeper

https://www.cnblogs.com/zhiyouwu/p/11546097.html

export ZOOKEEPER_HOME=/home/xyx/software/apache-zookeeper-3.8.0-bin

export PATH=$ZOOKEEPER_HOME/bin:$PATH

dataDir=/home/xyx/software/apache-zookeeper-3.8.0-bin/run/data

dataLogDir=/home/xyx/software/apache-zookeeper-3.8.0-bin/run/log

启动

./zkServer.sh start

hadoop

https://dlcdn.apache.org/hadoop/common/stable/

建议在/opt 文件夹下放文件夹,每个虚拟机的位置要一样。

环境变量:

export HADOOP_HOME=/home/xyx/software/hadoop-3.3.4

export PATH=${HADOOP_HOME}/bin:$PATH

一些配置

vim /root/hadoop-3.1.4/etc/hadoop/hadoop-env.sh

JAVA_HOME=/home/xyx/software/jdk1.8.0_341

JRE_HOME=/home/xyx/software/jdk1.8.0_341/jre

export HDFS_NAMENODE_USER=root

export HDFS_DATANODE_USER=root

export HDFS_SECONDARYNAMENODE_USER=root

export YARN_RESOURCEMANAGER_USER=root

export YARN_NODEMANAGER_USER=root

下面这些配置在hadoop-3.3.4/etc/hadoop下面

- 修改core-site.xml #核心模块配置

在

<!-- 设置默认使用的文件系统 Hadoop支持file、HDFS、GFS、ali|Amazon云等文件系统 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop-node1:8082</value>

</property>

<!-- 设置Hadoop本地保存数据路径 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/bigdata/hadoop/data/hadoop-3.3.4</value>

</property>

<!-- 设置HDFS web UI用户身份 -->

<property>

<name>hadoop.http.staticuser.user</name>

<value>root</value>

</property>

<!-- 聚合hive 用户代理设置 -->

<property>

<name>hadoop.proxyuser.hosts</name>

<value>*</value>

</property>

<!-- 用户代理设置 -->

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

<!-- 文件系统垃圾桶保存时间 -->

<property>

<name>fs.trash.interval</name>

<value>1440</value>

</property>

- hdfs-site.xml #hdfs文件系统模块配置

在

<!-- 设置SNN进程运行机器位置信息 -->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop-node2:9868</value>

</property>

<!-- 必须将dfs.webhdfs.enabled属性设置为true,否则就不能使用webhdfs的LISTSTATUS、LISTFILESTATUS等需要列出文件、文件夹状态的命令,因为这些信息都是由namenode来保存的。 -->

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

- 修改mapred.xml #MapReduce模块配置

在

<!-- 设置MR程序默认运行模式,yarn集群模式,local本地模式 -->

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<!-- MR程序历史服务地址 -->

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop-node1:10020</value>

</property>

<!-- MR程序历史服务web端地址 -->

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop-node1:19888</value>

</property>

<!-- yarn环境变量 -->

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<!-- map环境变量 -->

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

<!-- reduce环境变量 -->

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=${HADOOP_HOME}</value>

</property>

- 修改yarn-site.xml #yarn模块配置

在

<!-- 设置YARN集群主角色运行集群位置 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop-node1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 是否将对容器实施物理内存限制 -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<!-- 是否将对容器实施虚拟内存限制 -->

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

<!-- 开启日志聚集 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 设置yarn历史服务器地址 -->

<property>

<name>yarn.log.server.url</name>

<value>http://hadoop-node1:19888/jobhistory/logs</value>

</property>

<!-- 设置yarn历史日志保存时间 7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604880</value>

</property>

分发同步hadoop安装包到另外几台机器

scp -r hadoop-3.3.1 hadoop-node2:/opt/bigdata/hadoop/server/

确保另外几台机器的hadoop及依赖都能启动

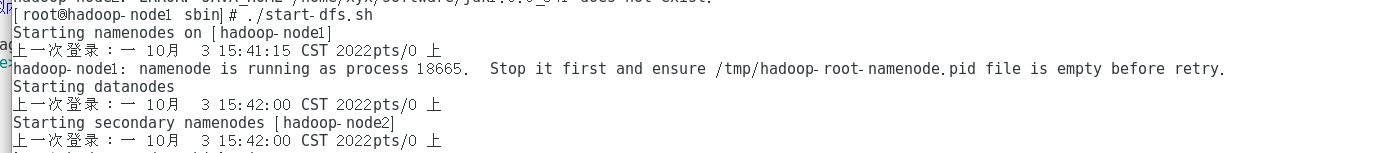

启动hadoop

hdfs namenode -format

hdfs

start-dfs.sh

stop-dfs.sh

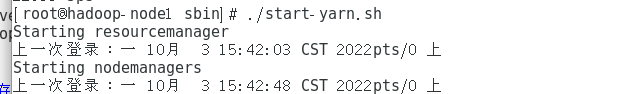

yarn

start-yarn.sh

stop-yarn.sh

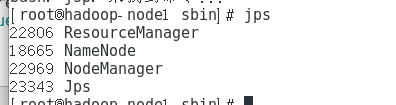

查看java进程

jps

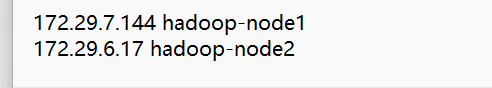

| 虚拟机 | ip | 操作系统 | 名字 |

|---|---|---|---|

| xyx | 172.29.7.144/23 | centos7.5 | hadoop-node1 |

| xyx2 | 172.29.6.17/23 | centos7.5 | hadoop-node2 |

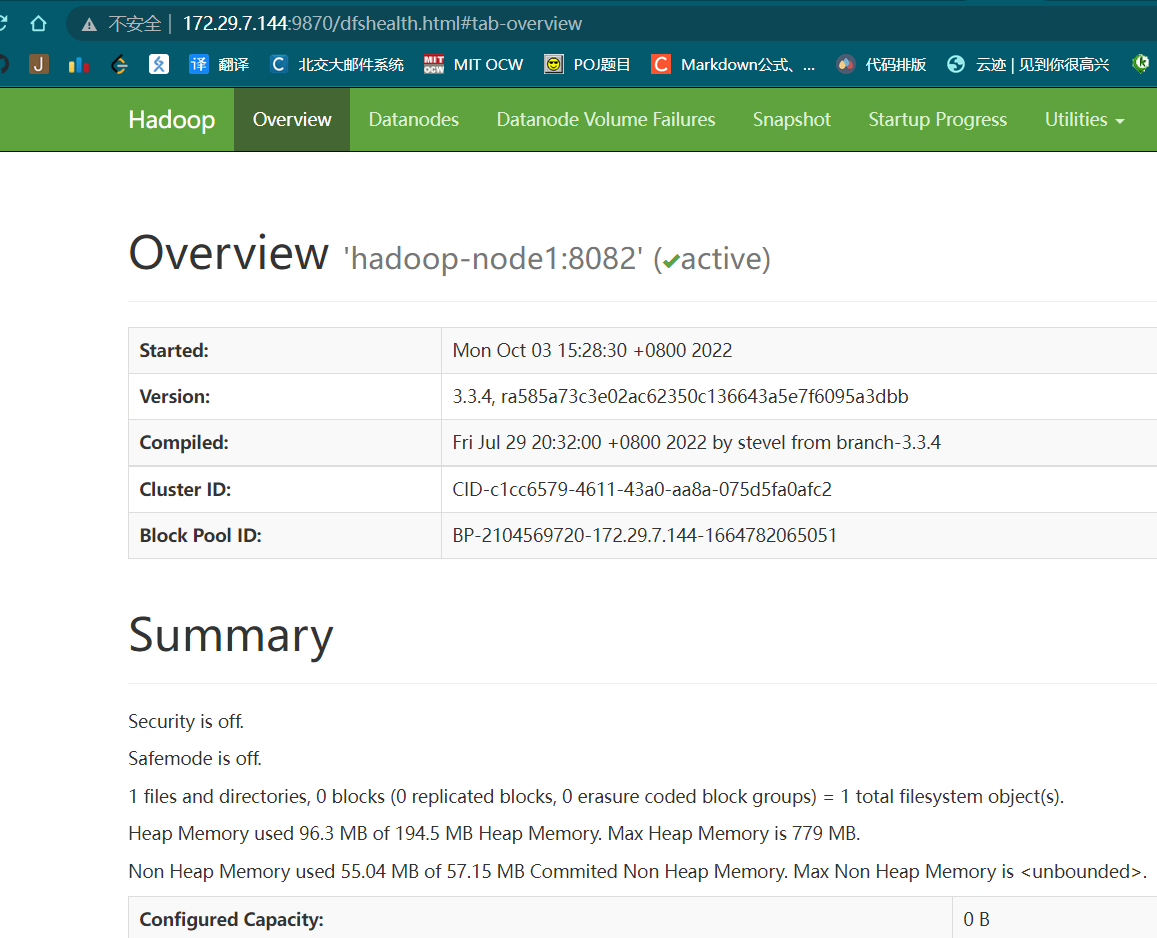

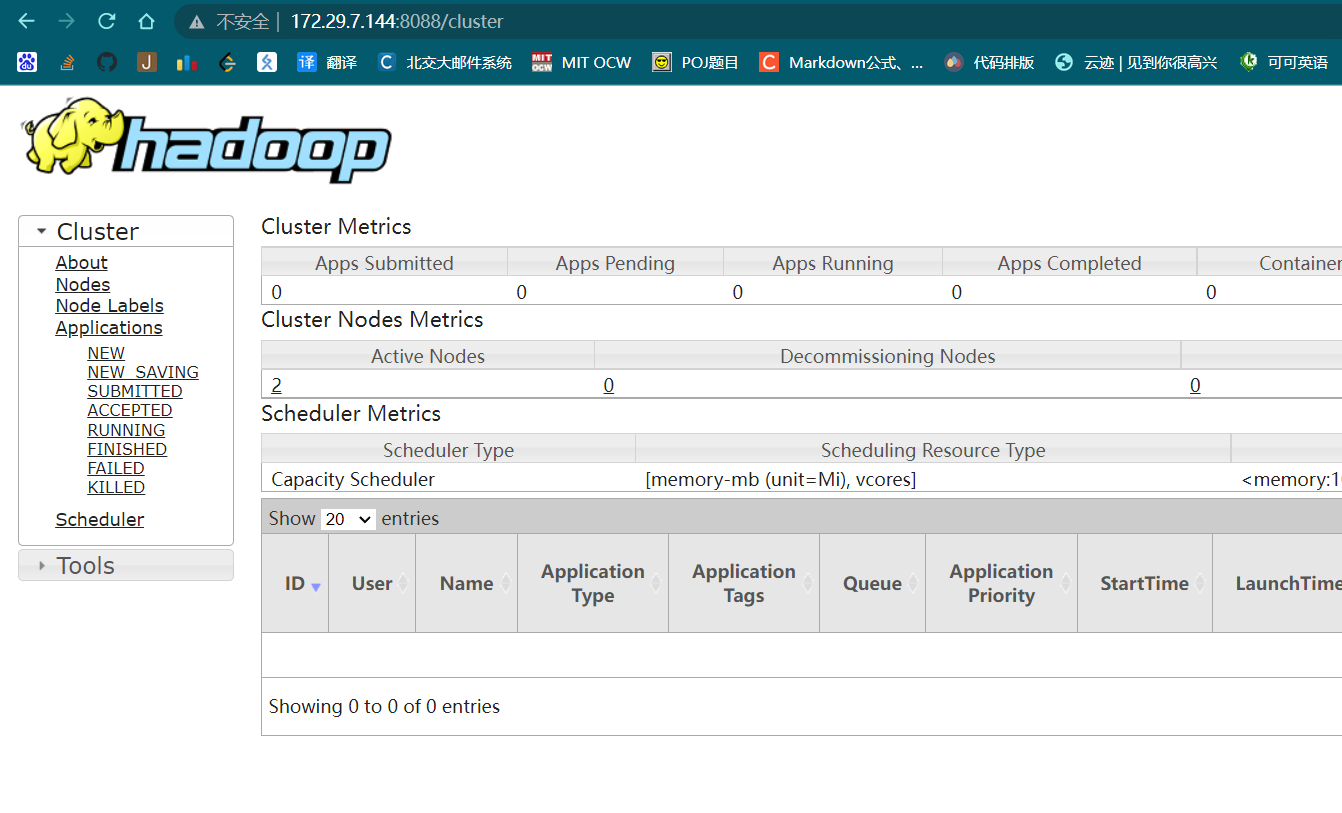

在web页面访问

在另一台主机上,比如windows添加hosts文件

C:\Windows\System32\drivers\etc\hosts

通过 http://namenode_host:9870 http://resourcemanager_host:8088访问

hbase

http://archive.apache.org/dist/hbase/2.3.3/

git

https://blog.csdn.net/qq_35453862/article/details/123353721